Addiction Meta : le verdict historique de 375 M$ qui change tout

Par la rédaction CTRLZed · 30 mars 2026 · 12–15 min de lecture

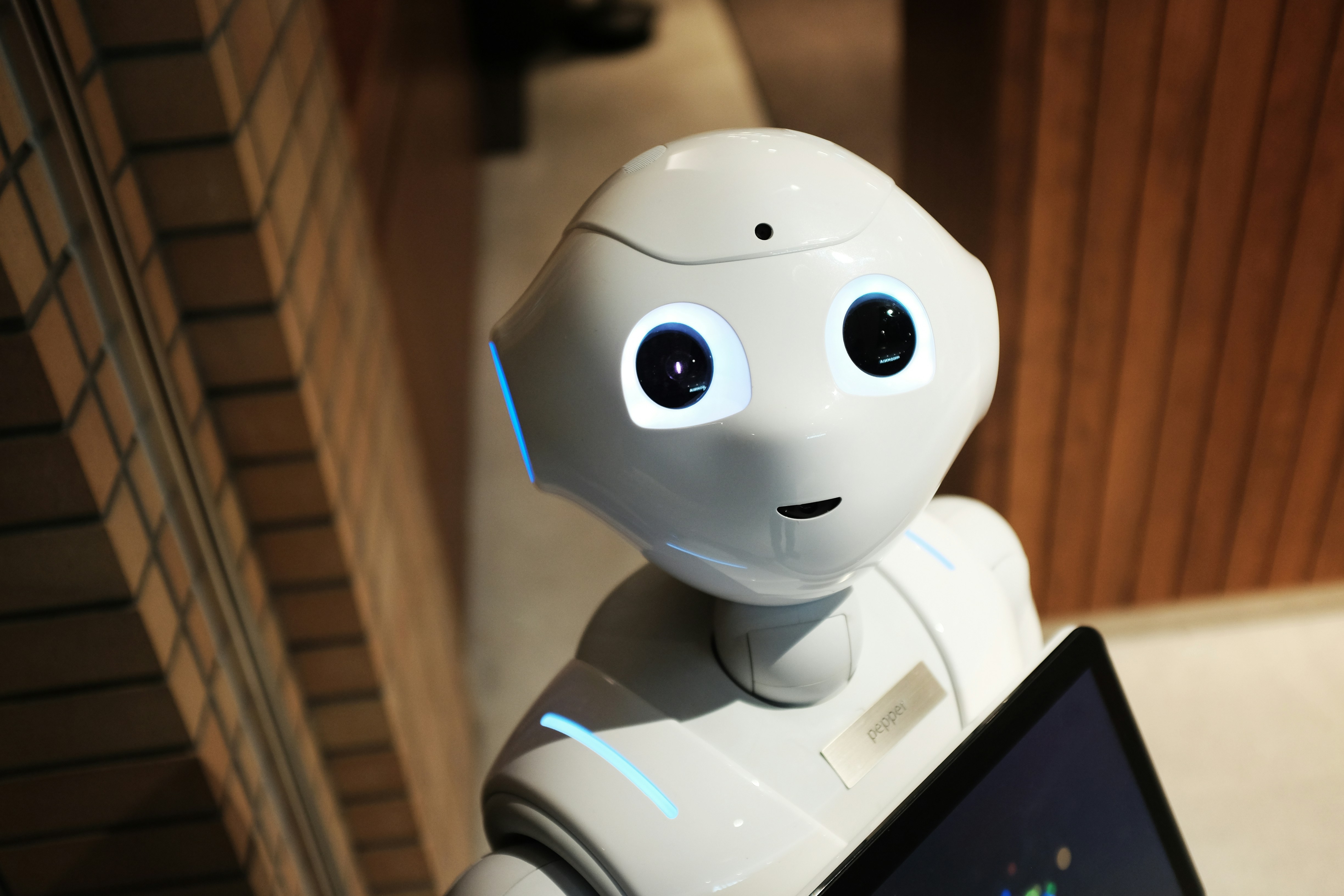

Le 24 mars 2026, deux jurés américains ont rendu, le même jour, des verdicts susceptibles de remodeler l’économie de l’attention. Au Nouveau-Mexique, un jury de Santa Fe condamne Meta à verser 375 millions de dollars pour avoir mis des enfants en danger sur Facebook et Instagram. Quelques heures plus tard, à Los Angeles, un second jury reconnaît Instagram et YouTube coupables de« conception addictive » ayant porté atteinte à la santé mentale d’une jeune femme. Pour la première fois dans l’histoire judiciaire américaine,ce ne sont plus les contenus publiés par des tiers qui sont en cause, mais la mécanique même des réseaux sociaux, leurs algorithmes, leurs boucles d’engagement, leur défilement infini.

Pour les juristes, les deux verdicts actent une rupture stratégique : le dépâssement partiel du bouclier Section 230, texte totémique de 1996 qui immunisait jusqu’ici les plateformes contre presque toute responsabilité civile. Ce sont plus de 2 172 procès similaires qui attendent, en fidèle procession, leur passage devant un jury.

Chronologie : dix ans de pressions avant le verdict

2021

Frances Haugen, lanceuse d’alerte chez Meta, divulgue des documents internes montrant que l’entreprise savait qu’Instagram nuisait à la santé mentale des adolescentes.

Nov. 2023

Arturo Béjar, ex-directeur Ingénierie chez Facebook, témoigne devant le Congrès. Il décrit des alertes ignorées par la direction et cite l’expérience de sa propre fille harcelée sur Instagram.

2023–2024

Une coalition de 41 États américains engage des poursuites contre Meta pour « conception intentionnellement addictive ». Le dossier MDL 3047 est ouvert à l’échelle fédérale.

2024

Le dossier du Nouveau-Mexique (proc. Raoul Torrez) s’appuie sur une opération d’infiltration : des agents créent de faux profils de mineurs et documentent la réception immédiate de sollicitations sexuelles.

Févr. 2026

Mark Zuckerberg témoigne en personne devant le tribunal de Los Angeles. Adam Mosseri (Instagram) est également à la barre.

24 mars 2026

Double verdict historique : 375 M$ au Nouveau-Mexique ; 6 M$ à Los Angeles. Meta annonce un appel dans les deux affaires.

Juin 2026

Troisième procès pilote fédéral programmé à Oakland (Californie) ; prochaine étape du contentieux de masse.

L’affaire du Nouveau-Mexique : 375 millions pour tromperie et mise en danger

Le procès de Santa Fe a duré sept semaines. Le procureur général Raúl Torrez accusait Meta d’avoir violé l’Unfair Practices Act de l’État en induisant les consommateurs en erreur sur la sécurité de Facebook, Instagram et WhatsApp, et en permettant sciemment l’exploitation sexuelle d’enfants sur ces plateformes.

Après moins d’une journée de délibérations, le jury a retenu l’intégralité des chefs d’accusation.

Il a reconnu Meta coupable d’avoir formulé des déclarations fausses ou trompeuses et d’avoir délibérément exploité la vulnérabilité des mineurs par la conception de ses plateformes.

“Ce verdict est une victoire historique pour chaque enfant et chaque famille qui a payé le prix des choix de Meta (...) celui de placer les profits avant la sécurité des jeunes.”

— Raúl Torrez, procureur général du Nouveau-Mexique, 24 mars 2026

Les chiffres clés du dossier

375 000 000 $ : montant de la condamnation (plafond légal de 5 000 $ par violation, pour des milliers de violations distinctes)

2,1 milliards $ : somme initialement réclamée par le procureur Torrez

40 témoins ont défilé à la barre, dont plusieurs lanceurs d’alerte internes

16 % des utilisateurs d’Instagram ont vu du contenu nu ou sexuel non souhaité en une seule semaine (documents internes Meta)

13 % des 13-15 ans déclaraient avoir reçu des avances sexuelles importunes sur Instagram dans les sept derniers jours (données internes Meta citées par Arturo Béjar)

Le témoignage d’Arturo Béjar : la voix du dedans

Arturo Béjar a travaillé chez Meta en deux périodes successives, notamment comme directeur Ingénierie de Facebook, avant de devenir consultant spécialisé en sécurité. Sa particularité : être aussi un père. En 2021, sa fille de 16 ans a reçu des avances sexuelles sur Instagram après avoir publié une story sur les voitures.

Il en a immédiatement informé Mark Zuckerberg par e-mail. Sans réponse.

Au procès de Santa Fe, Béjar a présenté des vidéos de test montrant des comptes fictifs enregistrés au nom d’une adolescente de 13 ans : en quelques minutes, l’algorithme Instagram y diffusait du contenu sexuel explicite.

Il a révélé que les systèmes de « contrôle du contenu sensible » destinés aux mineurs étaient en place depuis des années lorsque ces tests ont été menés.

“Je peux affirmer avec certitude que les dirigeants de Meta étaient conscients du tort fait aux adolescents, qu’ils pouvaient agir et qu’ils ont choisi de ne pas le faire.”

— Arturo Béjar, devant le Congrès américain, novembre 2023

En novembre 2023, devant la sous-commission sénatoriale sur la vie privée et la technologie, Béjar avait déjà alerté sur le fait que 13 % des 13-15 ans signalaient des avances sexuelles importunes sur Instagram au cours des sept derniers jours.

Ces données, issues d’analyses internes de Meta, n’avaient jamais été rendues publiques par l’entreprise.

Le procès de Los Angeles : la conception addictive sur le banc des accusés

Simultanément, dans un tribunal californien, une affaire distincte traitait d’une problématique parallèle. « Kaley », jeune femme de 20 ans identifiée par ses initiales KGM, a témoigné avoir commencé à utiliser YouTube à six ans et Instagram à neuf ans.

Elle a développé une dépression, des troubles anxieux et une dysmorphie corporelle qu’elle relie directement à une surexposition aux plateformes. TikTok et Snapchat, co-défendeurs dans ce dossier, ont négocié des accords amiables avant l’ouverture du procès.

Après plus de 40 heures de délibérations réparties sur neuf jours, le jury a considéré que le défilement infini, la lecture automatique et les systèmes de notifications constituaient un facteur « substantiel » dans les préjudices subis par la plaignante.

Les dommages-intérêts accordés s’élèvent à 3 millions de dollars compensatoires et 2,1 millions punitifs, Meta étant tenu responsable à hauteur de 70 %, YouTube à 30 %.

Ce que le jury a retenu

• Défilement infini (« infinite scroll ») : conception sans limite naturelle d’arrêt

• Autoplay vidéo : lecture chaînée automatique sans action de l’utilisateur

• Notifications push : conception exploitée pour créer une dépendance au retour sur la plateforme

• Algorithmes de recommandation : optimisation de l’engagement au détriment du bien-être

Un juré a déclaré aux journalistes que le témoignage de Mark Zuckerberg en personne« n’avait pas été bien perçu par le jury ». Interrogé sur le fait que l’addictivité d’une plateforme augmente son usage, Zuckerberg avait répondu :« Je ne suis pas sûr de ce qu’il faut dire à cela. Je ne pense pas que cela s’applique ici. »

La Section 230 : le bouclier qui se fissure

Depuis 1996, l’article 230 du Communications Decency Act (47 U.S.C. § 230) immunise les plateformes numériques contre toute responsabilité civile pour les contenus publiés par leurs utilisateurs. Le texte est concis : « No provider or user of an interactive computer service shall be treated as the publisher or speaker of any information provided by another information content provider. »

C’est sur ce texte que Meta, Google, Twitter et leurs semblables s’appuyaient systématiquement pour obtenir le rejet des plaintes avant même un examen au fond.

La stratégie des plaignants dans les deux procès de mars 2026 était précisément conçue pour contourner ce bouclier : plutôt que d’attaquer les contenus produits par des tiers, elle visait les décisions de conception des plateformes elles-mêmes ; les algorithmes, les paramètres par défaut, les mécanismes de vérification d’âge. Ces éléments ne sont pas produits par des tiers : ils sont l’œuvre propre des entreprises.

“Section 230 n’offre pas de protection pour les décisions de conception délibérées qui visent à rendre les jeunes utilisateurs dépendants, comme le défilement infini ou les notifications push.”

— Avocat Matthew Bergman, devant la commission sénatoriale Commerce, 18 mars 2026

En confirmant cette théorie du « défaut de produit » (product defect liability), les deux jurys ont ouvert une voie inexplorée. Le juge Kuhl, à Los Angeles,avait préalablement qualifié les décisions de conception algorithmique d’« activités entrepreneuriales susceptibles d’être soumises à l’évaluation d’un jury ». Ce précédent pourrait s’avérer durable.

375 millions :une amende symbolique pour Meta ?

Pour mesurer l’impact réel de la condamnation, les chiffres comptables de Meta s’imposent.En 2025, le groupe a dégagé un résultat d’exploitation de 83,28 milliards de dollars, avec une marge opérationnelle de 41,4 %.

Capitalisation boursière: environ 1 500 milliards de dollars. Dans ce contexte, 375 millions représentent moins de 0,5 % du chiffre d’affaires annuel de l’entreprise : une somme que la procédure du Nouveau-Mexique elle-même reconnut comme« symbolique » au regard de la puissance financière de Meta.

Mise en perspective financière

375 M$ = 0,45 % du chiffre d’affaires annuel Meta

Le procédure du Nouveau-Mexique avait réclamé 2,1 Md$ (réduit au plafond légal)

Actions Meta +0,8 % après l’annonce du verdict, les marchés ne paniquent pas

Prochain enjeu : la phase de « dommages punitifs », encore à venir dans l’affaire du Nouveau-Mexique

Si les 2 172 procès en attente aboutissent, les experts parlent de « dizaines de milliards » de dollars d’exposition

Pour le professeur Peter Ormerod (Villanova University, droit), le verdict est« un développement majeur » mais il représente « une étape dans une saga beaucoup plus longue ».

L’avocat Tre Lovell avertit toutefois :« Ce verdict constitue une exposition réelle pour les géants des réseaux sociaux et va structurer les litiges futurs. »

Le véritable risque financier n’est pas dans le montant du premier verdict, mais dans le précédent juridique qu’il établit pour les 2 000 affaires restantes.

La comparaison avec l’industrie du tabac s’impose d’elle-même dans les commentaires juridiques. En 1998, le Master Settlement Agreement avait contraint les quatre principaux cigarettiers américains à verser 206 milliards de dollars sur 25 ans. La question que posent ces deux verdicts : les réseaux sociaux sont-ils les prochains sur la liste ?

La réponse européenne : du DSA à la loi française

Les deux verdicts américains résonnent dans un contexte réglementaire européen en pleine évolution. Henna Virkkunen, vice-présidente de la Commission européenne chargée de la souveraineté technologique, a salué la décision de justice, rappelant que le Digital Services Act (DSA) imposait déjà aux grandes plateformes de prendre leurs responsabilités en matière de protection des mineurs.

Le DSA en pratique

Entré pleinement en vigueur en 2024, le DSA impose aux « très grandes plateformes en ligne » (VLOP), dont Meta et YouTube, des obligations spécifiques au titre des articles 34 et 35 : évaluation des risques pour les droits et le bien-être des enfants, implémentation de mesures d’atténuation, interdiction de la publicité ciblée fondée sur le profilage pour les moins de 18 ans. La Commission européenne a déjà ouvert des procédures formelles contre Meta (Facebook et Instagram) et TikTok au titre du DSA.

Ce que le DSA interdit déjà

• Publicité ciblée basée sur le profilage pour les mineurs (art. 28)

• Interfaces trompeuses décourageant le signalement de contenus illicites

• Systèmes de recommandation algorithmique non contrôlables par l’utilisateur

• Absence d’évaluation formelle des risques spécifiques aux mineurs

La France dans l’élàn

En France, le législateur n’est pas resté passif. Le 26 janvier 2026, l’Assemblée nationale a adopté en première lecture une proposition de loi visant à interdire l’accès aux réseaux sociaux aux moins de 15 ans. Ce texte fait suite aux conclusions d’une commission d’enquête sur les effets psychologiques de TikTok sur les mineurs, laquelle a établi qu’aucun réseau social parmi les principaux ne pouvait être qualifié d’« éthique ».

Le texte était examiné au Sénat le 25 mars 2026, la veille même des deux condamnations américaines.

Les données françaises confirment l’urgence : selon l’Arcom (2025), 44 % des adolescents étaient inscrits sur les réseaux sociaux avant 13 ans, 62 % contournaient les règles d’âge, et plus de 80 % en faisaient un usage quotidien.

Le gouvernement français prévoit une entrée en vigueur de l’interdiction dès la rentrée 2026 pour les nouveaux comptes, avec une mise en conformité des comptes existants avant le 31 décembre 2026. Les plateformes s’exposeraient à une amende pouvant atteindre 6 % de leur chiffre d’affaires mondial en cas de non-respect.

Implications juridiques : ce qui change réellement

Au-delà du montant des condamnations, les deux verdicts de mars 2026 déplacent le centre de gravité du droit de la responsabilité numérique. Trois ruptures méritent d’être soulignées.

1. La conception comme « défaut de produit »

En assimilant les décisions algorithmiques à des défaillances de conception, au sens du droit de la responsabilité du fait des produits, les juries américains permettent d’attaquer les plateformes non pour ce qu’elles hébergent, mais pour ce qu’elles fabriquent.

Cette approche évite le bouclier Section 230 tout en créant un cadre potentiellement applicable aux algorithmes de recommandation dans d’autres contextes : presse, e-commerce, jeux vidéo.

2. La responsabilité pour connaissance des risques

Les documents internes produits au procès ont établi que Meta avait connaissance, depuis au moins 2021, des taux élevés de harcèlement sexuel sur ses plateformes. Le jury a considéré que l’entreprise avait « délibérément exploité la vulnérabilité des mineurs » même en ayant cette connaissance.

En droit européen, ce scénario correspond exactement aux « risques systémiques » que les articles 34 et 35 du DSA obligent les VLOP à évaluer et à atténuer.

3. Les accélérateurs procéduraux : les procès bellwether

Dans le dossier fédéral MDL 3047, les deux procès de mars 2026 étaient des « procès tests » (bellwether trials) : des affaires choisies pour jauger comment les arguments des deux parties se comportent devant un jury, avant une éventuelle négociation globale.

Chaque verdict favorable aux plaignants renforce mécaniquement la position des demandeurs dans les procès suivants et augmente la pression vers un accord global. L’analogie avec le tabac (Master Settlement Agreement, 1998) ou les opioïdes est explicitement formulée par les experts.

Ce que vous pouvez faire : guide pratique en 5 étapes

1 Vérifiez les paramètres de votre compte (et de ceux de vos enfants)

Sur Instagram et Facebook : Paramètres → Confidentialité → Compte superviseur. Activez le « mode de surveillance parentale ». Limitez les recommandations via Paramètres → Contenu → Sujets à moins voir.

2 Signalez tout contenu inapproprié reçu par un mineur

En France, la plateforme Pharos (Internet-signalement.gouv.fr) centralise les signalements de contenus illégaux. Pour les actes à caractère sexuel sur mineurs, le signalement à la police ou à la gendarmerie est obligatoire pour tout adulte en ayant connaissance (art. 434-3 Code pénal).

3 Gardez les preuves avant suppression

Toute communication à caractère sexuel reçue par un mineur constitue un élément de preuve. Capturez les écrans avec date et heure visibles, notez les URL de profil, et ne répondez pas avant d’avoir documenté.

4 Explorez les voies d’action collective en Europe

La jurisprudence américaine est non-contraignante en France, mais elle alimente les procédures du DSA. Des associations comme « Algos Victima » ou des collectifs de parents se structurent pour engager des actions collectives européennes. La décision de la Commission sur Meta (en cours) pourrait ouvrir la voie à des indemnisations en UE.

5 Suivez l’évolution législative française

La proposition de loi (interdiction -15 ans) est en cours d’examen sénatorial. Sa mise en œuvre effective et notamment les systèmes de vérification d’âge créeront de nouvelles obligations pour les plateformes et de nouveaux droits pour les familles. Consultez régulièrement les ressources officielles de l’Arcom et de la Cnil.

Questions fréquentes

Le verdict américain s’applique-t-il en France ?

Non, directement. Les verdicts des jurés américains n’ont pas d’effet contraignant dans l’Union européenne. En revanche, ils alimentent les procédures DSA de la Commission européenne et renforcent les arguments juridiques des associations de victimes françaises et européennes.

Qu’est-ce que la Section 230 et pourquoi son contournement est-il historique ?

L’article 230 du Communications Decency Act (1996) immunise les plateformes numériques américaines contre toute responsabilité civile pour les contenus publiés par leurs utilisateurs. En ciblant les décisions de conception algorithmique plutôt que les contenus tiers, les plaignants ont contourné ce bouclier légal pour la première fois devant un jury. C’est la première reconnaissance judiciaire de l’addiction numérique comme préjudice légal.

Meta va-t-il vraiment payer les 375 millions ?

Meta a annoncé faire appel dans les deux affaires. L’appel suspend généralement l’exécution forcée du jugement. Le montant final pourrait être réduit en appel ou négocié dans le cadre d’un accord global. Par ailleurs, la phase de « dommages punitifs » dans l’affaire du Nouveau-Mexique n’a pas encore été jugée : elle pourrait porter la facture bien au-delà des 375 millions.

Quelles plateformessont concernées par le dossier fédéral MDL 3047 ?

Le dossier MDL 3047 regroupe plus de 2 172 plaintes fédérales visant Meta (Facebook, Instagram), TikTok,YouTube (Google/Alphabet) et Snapchat. Des procès similaires sont menés par plus de 40 procureurs généraux d’États américains. Le prochain procès test est programmé en juin 2026 à Oakland, en Californie.

Le DSA européen peut-il produire des effets similaires ?

En théorie, oui. Les articles 34 et 35 du DSA obligent les très grandes plateformes à évaluer et atténuer les risques spécifiques aux mineurs, y compris ceux liés aux systèmes de recommandation algorithmique. La Commission européenne a déjà ouvert des procédures formelles contre Meta et TikTok. Les sanctions maximales prévues par le DSA peuvent atteindre 6 % du chiffre d’affaires mondial.

Un parent peut-il agir en France si son enfant a subi un préjudice sur Instagram ?

Oui. Plusieurs voies existent : plainte pénale pour harcèlement, atteinte sexuelle ou cyberharcèlement ; signalement à la CNIL pour violation du RGPD (notamment l’article 8 sur le consentement des mineurs) ; et, à terme, participation à des procédures collectives européennes en cours de structuration. CTRLZed ne peut pas vous conseiller individuellement, mais peut vous orienter vers les ressources de l’e-Enfance (3018) et du service-public.fr.

⚠Avertissement — CTRLZed n’est pas un cabinet d’avocats : Les contenus publiés sur CTRLZed Media ont une vocation exclusivement informative et pédagogique. Ils ne constituent pas de conseils juridiques et ne sauraient engager la responsabilité de la rédaction. Pour toute situation personnelle ou professionnelle, consultez un professionnel du droit qualifié.