Harcèlement numérique : la modération automatisée peut-elle protéger sans censurer ?

Depuis l’avènement des réseaux sociaux et des plateformes en lignes, ces dernières décennies ont permis le développement massif de nouvelles technologies decommunication, favorisant un espace numérique prometteur et propice aux échanges entre les individus, parfois même au détriment de leur vie privée. Defacto, face à ce développement massif, l’ascension d’un nouveau phénomène est largement constatée : le harcèlement en ligne.

Le cyberharcèlement : une menace omniprésente dans le quotidien de tous

Selon un rapport publié par Statista en 2025, en 2023, plus de 60 % des jeunes et 40 % des adultes ont été victimes d’au moins une forme de cyberharcèlement. Face à ces chiffres, 29% des victimes déclarent avoir penser au suicide, illustrant les conséquences dramatiques de ces actes. Les plateformes comme WhatsApp ainsi que d’autres réseaux sociaux sont les principaux canaux, avec un taux de 44% de jeunes victimes notamment ayant été harcelées sur WhatsApp.

Des conséquences dramatiques et hors de portée

Quoi que la grande préoccupation du harcèlement soit un sujet d’État depuis de nombreuses années, le développement de l’accès aux plateformes numériques n’a pas résolu le problème. En effet, alors qu’il y a un certain nombre d’années le harcèlement s'arrêtait aux portes des écoles, lieux de travail et permettait plus aisément d’identifier les bourreaux… Désormais, il se poursuit en ligne, d’une violence exacerbée, sans aucun contrôle de la part des autorités sur ce phénomène. Ces faits rappellent l’affaire Marion fraisse, une jeune collégienne s’étant ôtée la vie en 2013 à la suite d’harcèlement, donnant lieu au roman Marion, 13 ans pour toujours, le harcèlement tue rédigépar la mère de la victime : « Sous ton lit en hauteur, on a trouvé ton téléphone portable, attaché au bout d’un fil, pendu lui aussi pour couper symboliquement la parole à ceux qui, au collège, te torturaient à coups d’insultes et de menaces ».

Harcèlement numérique et point d’actualité

Si les dernières décennies regorgent d’exemples de cyberharcèlement, un cas récent tend à souligner davantage les conséquences plus que dramatiques du harcèlementnumérique. De facto, il s’agit de l’affaire Mehdi Bassit, jeune influenceur de 32 ans suivi par plus de 2 millions de personnes, décédé ce samedi 19 juillet 2025. Même s’il est important de souligner que les circonstances exactes de son décès ne sont pas connues pour l’instant, sur Tiktok, de nombreux individus notamment sa meilleure amie évoque le harcèlement dont il était victime sur les réseaux sociaux : « Ces derniers temps, il n’y avait plus que des larmes, de la tristesse et de la colère. C’était trop: trop de haine, trop de harcèlement, trop de calomnies, trop d’injustice. ». En effet, Mehdi était la cible de nombreuses attaques sur les réseaux sociaux.

Si cette affaire reste encore non résolue à ce jour, elle révèle cependant les limites des plateformes numériques face à ce phénomène de violence en ligne. En effet, force est de constater qu’il existe certains mécanismes protecteurs des utilisateurs comme l’existence de modérateurs chargés de supprimer tout contenu illicite ne respectant pas les règles de la plateforme. Cependant, certains contenus ou propos choquants traversent les mailles du filet, questionnant ainsi l’efficacité de ces mécanismes…

Face au cyber harcèlement : une solution la modération automatisée ?

Malgré que le harcèlement numérique soit puni au sein du code pénal (article 222-33-2-2)par deux ans d’emprisonnement et 30 000 € d’amende, le phénomène ne semble pourtant pas s’amenuir. En effet, même si ces dispositions restent d’une importance capitale en termes de responsabilité, encore faut-il pouvoir identifier le ou les coupables et les rendre responsable. Or, avec des réseaux sociaux d’une grande ampleur tels que Tiktok, il est parfois difficile de nommer un responsable lorsque le harcèlement numérique se fait parfois par vague de centaines de milliers d’utilisateurs qui profitent de l’anonymat pour agir.

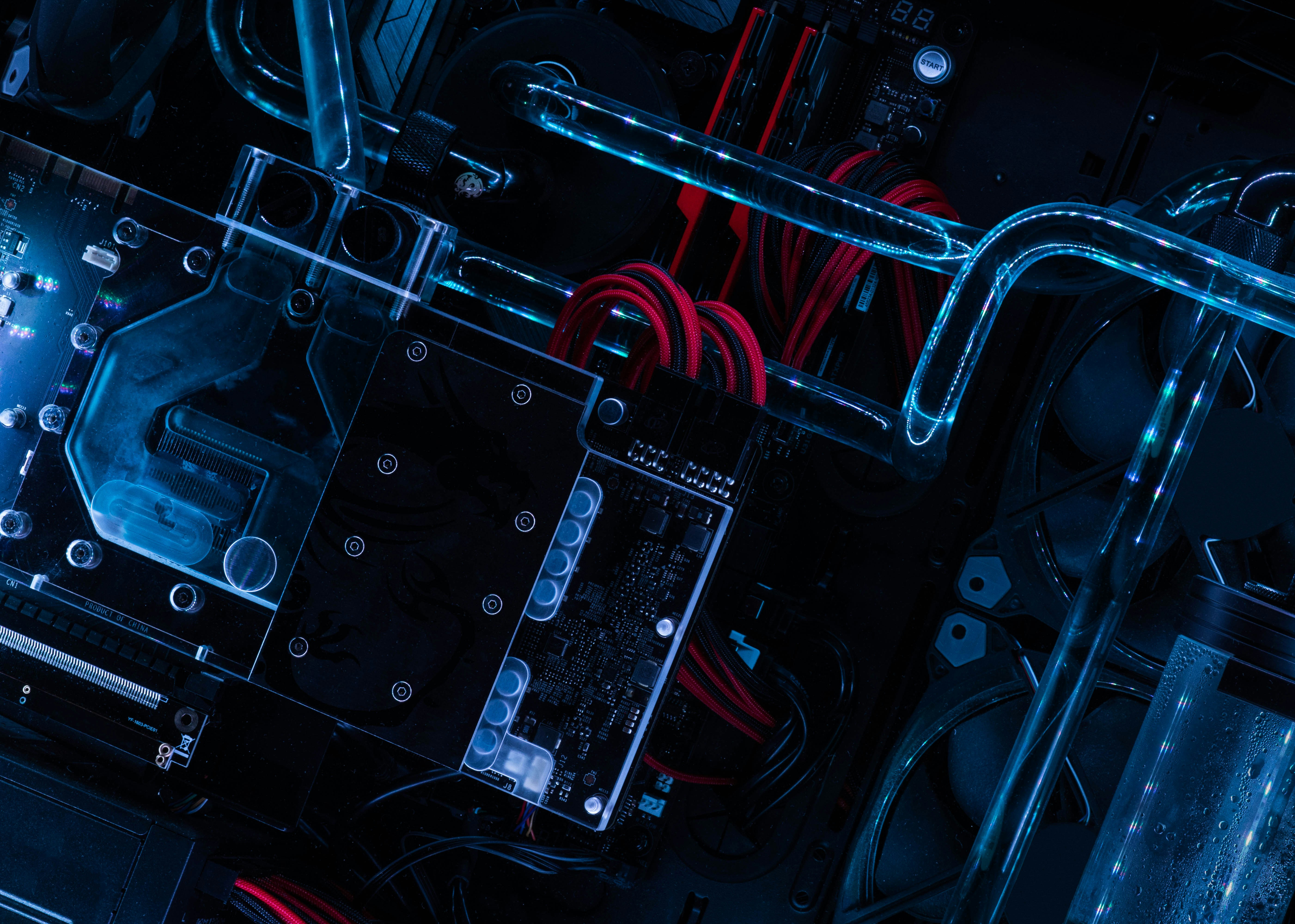

De ce fait, envisager une modération automatisée, sur la base d’intelligence artificielle et d’algorithmes serait positive tant que l’enjeu majeur pourrait être respecté. Ainsi, ce dernier serait de pouvoir protéger les utilisateurs contre le harcèlement grâce à des outils automatisés, sans pour autant porter atteinte de manière disproportionnée à la liberté d’expression, notamment par des suppressions injustifiées ou des erreurs d’interprétation algorithmique.

Modération automatisée : Peut-on protéger sans censurer ?

A ce jour, il est de rigueur de constater que de nombreux réseaux sociaux utilisent déjà la modération automatisée, souvent combinée avec une intervention humaine. Cela dit, peut-on vraiment juger cette méthode efficace ?

A titre illustratif, le célèbre réseau social Tiktok, créé en 2014 et regroupant près de 2,7 milliards d'utilisateurs en2025 dispose de ce mécanisme hybride avec d’une part l’existence de modérateurs humains, notamment pour les diffusions de contenus en direct appelés « Live » ainsi que la présence de l’IA afin de scanner en temps réelles contenus ou métadonnées utilisant de nombreux mécanismes tels que la reconnaissance vocale ou encore le NLP, traduit de l’anglais NaturalLanguage processing, permettant aux machines de comprendre, analyser ou encore traduire le langage humain… Tout ceci afin de repérer les contenus violents, sexuels ou dangereux.

De fait, avec un nombre colossal de contenus publiés chaque jour, Tiktok a recours à l'IA pour gérer ce volume massif efficacement. À ce titre, environ 80% des contenus violents les règles communautaire fixé par la plateforme sont retirés automatiquement sansi ntervention humaine. Cette dernière reste cependant utile dans certains cas, concernant notamment les contenus douteux que l'IA ne peut trancher de façon claire (contenus culturels ou sensibles comme la désinformation) ou encore les divers signalements des utilisateurs face à certains contenus jugés inappropriés.

Dès lors, ce constat permet ainsi d'affirmer que la plateforme engage une transition, vers une modération plus automatisée, tournée vers l'IA. En effet, selon un article issu notamment du média Reuters, dans un article publié par Rozanna Latiff, le 11 octobre 2024, L'IA est désormais la première ligne dans la lutte contre les contenus violents les règles de la plateforme, entraînant la réduction du recours au travail humainet supprimant par conséquence plusieurs centaines d'emplois notamment en Malaisie pour s'orienter vers une modération automatisée. Cependant, cette innovation soulève certaines préoccupations. En effet dans le cadre du harcèlement numérique, cette nouvelle modération pourtant prometteuse ne suffit pas à faire barrage aux diverses formes de violences parfois camouflées…

FAQ - Harcèlement numérique : la modération automatisée peut-elle protéger sans censurer ?

L’IA peut-elle alors vraiment remplacer l’intervention humaine pour juger certaines formes de violences parfois cachéessous formes sarcastiques ou humoristiques ?

Non, pas totalement.L’intelligence artificielle peut détecter des mots ou des expressions problématiques, mais elle a encore de grandes limites pour comprendre le ton, le contexte, ou l’intention d’un message. Le sarcasme ou l’humour, souvent très subtils, nécessitent une interprétation humaine. Confier ce type de jugement uniquement à une IA peut entraîner des erreurs de détection ou des censures injustifiées.

La régulation du harcèlement numérique est-elle vraiment efficace ?

Pas encore complètement.Même si les outils de modération automatique s’améliorent, le harcèlement en ligne reste un problème massif. Beaucoup de cas échappent encore à la détection, notamment lorsqu’ils prennent des formes indirectes, répétées ou privées. De plus, l'efficacité de la régulation dépend aussi de la réactivité des plateformes, du cadre légal, et de l’engagement des utilisateurs. Les progrès sont réels, mais la régulation est encore loin d’être pleinement efficace.

La régulation et la modération de contenusbasé uniquement sur des règles établies ne porte-t-elle pas atteinte à laliberté d'expression de chacun garantie par l’article 10 de la conventionEuropéenne des droits de l’homme et des libertés fondamentales ?

Oui, ce risque existe.L’article 10 protège la liberté d'expression, mais cette liberté peut être limitée pour protéger les droits d’autrui (notamment en cas de discours haineux ou de harcèlement). Le problème, c’est que des modérations automatisées ou trop rigides peuvent censurer des propos légitimes, mal interprétés par l’algorithme. Il est donc essentiel que la régulation soit proportionnée, transparente, et qu’elle inclue une intervention humaine pour les cas les plus sensibles.

Peut-on déléguer l’éthique à une machine ?

Non.Une machine ne possède ni conscience morale, ni compréhension des valeurs humaines. Elle peut appliquer des règles programmées, mais elle ne comprend pas les dilemmes éthiques, ni les nuances des situations humaines. Déléguer entièrement l’éthique à une IA reviendrait à supprimer la réflexion humaine dans des décisions pourtant complexes et sensibles. L’éthique doit rester une responsabilité humaine, même si l’IA peut aider à éclairer certains choix.

Auteure : Lucy Hersant