Pour ou contre l'IA : et si la vraie question était juridique ?

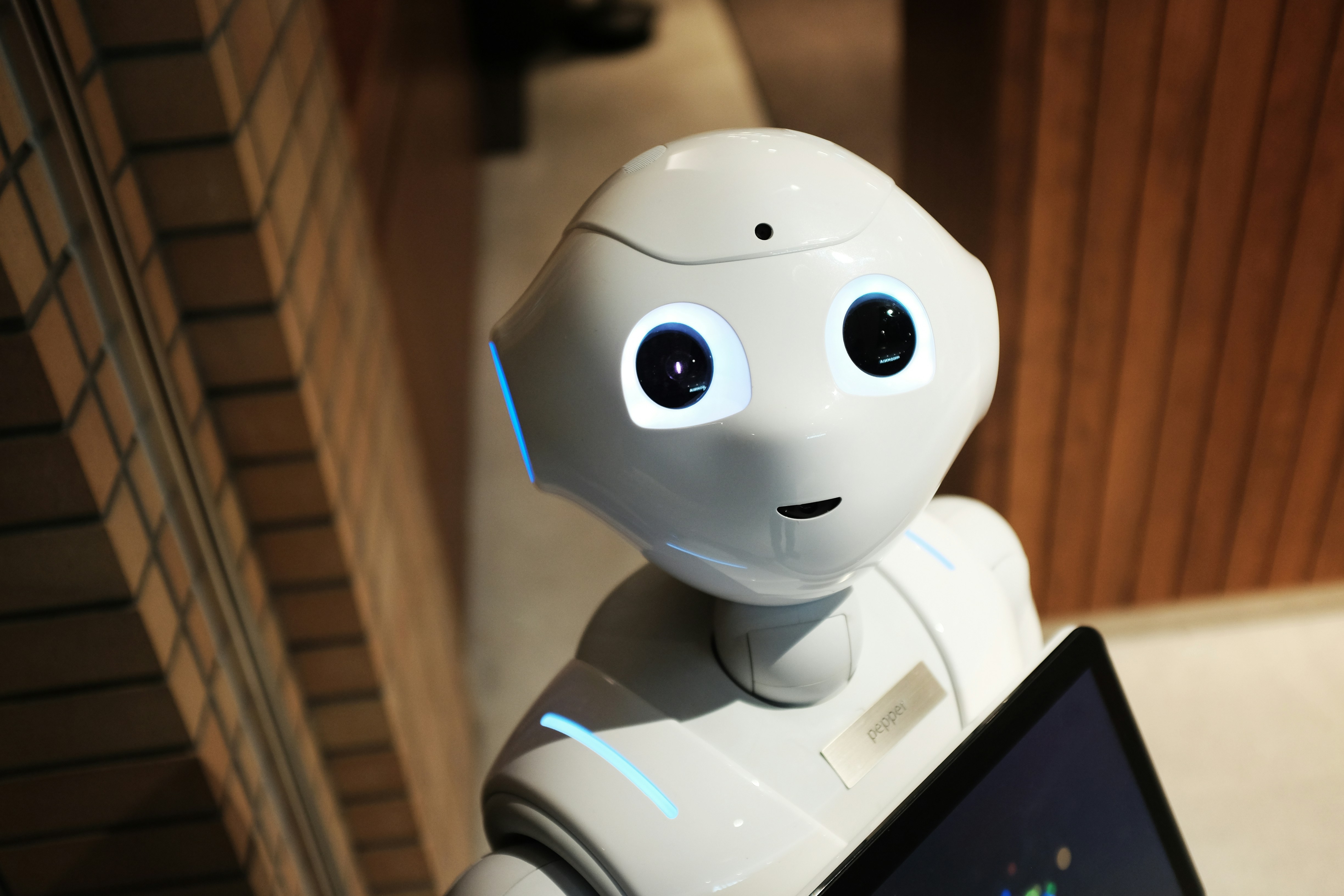

Chaque semaine,le débat refait surface. Faut-il être pour ou contre l'intelligenceartificielle ? D'un côté, ses défenseurs vantent la productivité gagnée, les diagnostics médicaux accélérés, l'accès démocratisé au savoir.

De l'autre, ses détracteurs dénoncent les suppressions d'emplois, la surveillance de masse, la créativité dépossédée. Deux camps, deux discours et, entre les deux, une question que presque personne ne pose : qui est responsable ?

C'est précisément là que le droit entre en scène. Pas pour trancher le débat, mais pour le déplacer. Car avant de choisir un camp, il faut comprendre dans quel cadre légal l'IA opère aujourd'hui et quelles failles béantes ce cadre laisse encore ouvertes.

Être« pour » ou « contre » l'IA sans interroger sa régulation, c'est discuter du feu sans parler des pompiers.

Un débat mal posé dès le départ

L'IA n'est pas un bloc monolithique

L'intelligence artificielle recouvre des réalités radicalement différentes : un algorithme de recommandation musicale, un système de scoring crédit, un modèle génératif de texte ou un outil de reconnaissance faciale en temps réel n'ont pas les même simplications ni les mêmes risques.

Raisonner en termes de « pour ou contre l'IA » revient à dire qu'on est « pour ou contre la chimie » : l'abstraction masque l'essentiel.

C'est précisément l'approche retenue par le législateur européen dans l'AI Act(Règlement UE 2024/1689), entré en vigueur en août 2024. Plutôt que d'interdire ou d'autoriser l'IA en bloc, il classe les systèmes par niveau de risque et adapte les obligations en conséquence.

Le droit comme boussole, pas comme verdict

Adopter une approche juridique du débat, ce n'est pas esquiver la question éthique. C'est l'ancrer dans des mécanismes concrets : qui déploie ce système ? Dans quel but? Avec quelle transparence ? Quels recours pour les personnes concernées ? Ces questions ont ou devraient avoir des réponses légales. Et c'est là que le débat « pour ou contre » trouve enfin un terrain solide.

Ce que le droit dit (et ne dit pas encore) sur l'IA

L'AI Act : une régulation par les risques

Le texte européen est historique. Première grande loi sectorielle dédiée à l'IA dans lemonde, il établit une hiérarchie claire :

• Risque inacceptable : interdiction absolue. Sontvisés la notation sociale généralisée, la manipulation comportementale subliminale, la reconnaissance faciale biométrique en temps réel dans les espaces publics (avec exceptions strictement encadrées).

• Risque élevé : obligations renforcées. Les IA utilisées dans l'emploi, le crédit, l'éducation, la justice ou les infrastructures critiques doivent satisfaire à des exigences de transparence,traçabilité et supervision humaine.

• Risque limité et minimal : obligations allégées,dont l'obligation d'informer l'utilisateur qu'il interagit avec un chatbot.

Ce cadre estambitieux. Mais il laisse en suspens des questions majeures : comment sanctionner une entreprise extra-européenne ? Comment évaluer l'impact d'un modèle dont les paramètres sont opaques ? La supervision humaine sera-t-elle autre chose qu'une formalité ?

Le RGPD face à l'IA générative : trois tensions majeures

Le Règlement Général sur la Protection des Données a été conçu avant l'explosion des modèles génératifs. Ses fondements sont aujourd'hui mis à l'épreuve sur trois pointscritiques.

"Toute image permettant d'identifier une personne est une donnée personnelle au sens du RGPD."

— Article 4, Règlement UE 2016/679

• Le droit à l'effacement : peut-on exiger qu'un LLM (modèle de langage) « oublie » une donnée personnelle qui a servi à sonentraînement ? Techniquement flou. Juridiquement obligatoire. Le fossé estconsidérable.

• La licéité du traitement : les données utilisées pour entraîner des modèles comme GPT ou Gemini ont-elles été collectées avec une base légale valide ? Plusieurs autorités (CNIL, Garante italienne, DPAirlandais) ont ouvert des enquêtes sans conclusion définitive à ce jour.

• La responsabilité des décisions automatisées : l'article 22 du RGPD encadre les décisions prises « uniquement » par traitement automatisé. La sophistication des systèmes hybrides humain + IA compliqueconsidérablement la qualification.

Le RGPD n'a pas été conçu pour les modèles fondationnels. L'adapter sans le vider de sa substance est l'un des défis centraux du droit numérique actuel.

Les angles morts : ce que le débat oublie

La responsabilité en chaîne

Qui est responsable quand une IA médicale produit un diagnostic erroné ? Le fabricant du modèle ? L'hôpital qui l'a déployé ? Le médecin qui a validé sans vérifier ?L'AI Act introduit les notions de « fournisseur » et de « déployeur » avec des responsabilités distinctes. Mais les chaînes de valeur de l'IA sont souvent longues, fragmentées et internationales, ce qui rend la responsabilité difficile à localiser.

La directive sur la responsabilité en matière d'IA (AI Liability Directive), en cours de transposition dans les États membres, vise à combler ce vide en introduisant une présomption de causalité en faveur des victimes. Une avancée réelle, mais encore fragile dans son application.

La propriété intellectuelle bousculée

ChatGPT écrit un roman. Midjourney génère une illustration. Suno compose une chanson. Qui est l'auteur ? Qui est titulaire des droits ? En droit français et européen, l'œuvre protégée par le droit d'auteur doit refléter la « création intellectuelle propre » d'un humain. Une œuvre purement générée par IA n'est, en l'état actuel, pas protégeable par le droit d'auteur.

Mais la question inverse est tout aussi explosive : les œuvres humaines ingérées parles modèles lors de l'entraînement bénéficient-elles d'une protection ? Des artistes, des éditeurs et des agences de presse ont engagé des procédures judiciaires aux États-Unis et en Europe. Le droit de la propriété intellectuelle se réécrit en temps réel, et Ctrlzed y consacrera un article complet.

L'empreinte écologique de l'IA : un préjudice en construction

C'est l'angle le plus sous-estimé du débat. L'entraînement et l'inférence des grands modèles d'IA consomment des volumes considérables d'énergie et d'eau. GPT-4 aurait nécessité plusieurs giga wattheures pour son entraînement. Une requête à un grand modèle génératif consomme en moyenne dix fois plus d'énergie qu'une recherche Google classique.

Or le droit environnemental numérique est encore balbutiant. La directive européenne CSRD impose désormais aux grandes entreprises de publier leur empreinte carbonenumérique, mais aucun texte ne cible spécifiquement les coûts environnementaux des modèles d'IA. La notion de « préjudice écologique numérique » n'est pas consacrée en droit positif. Mais les conditions de son émergence juridique sont réunies.

Peut-on poursuivre une entreprise tech pour le dommage environnemental causé par unusage excessif de ses modèles ? La question n'est pas encore tranchée. Mais elle sera posée et Ctrlzed lui consacrera un article dédié.

Quelles sanctions en cas de violation des règles IA ?

Les sanctions prévues par l'AI Act

L'AI Act prévoit un régime de sanctions administratives calqué sur le modèle du RGPD, avec des montants significatifs :

• Jusqu'à 35 millions d'euros ou 7 % du chiffre d'affaires mondial pour les violations les plus graves (systèmes interdits déployés quand même).

• Jusqu'à 15 millions d'euros ou 3 % du chiffre d'affaires pour le non-respect des obligations applicables aux systèmes à hautrisque.

• Jusqu'à 7,5 millions d'euros ou 1,5 % du chiffre d'affaires pour fourniture d'informations inexactes aux autorités.

En France, c'est la CNIL qui devrait jouer un rôle central dans la supervision, en coordination avec les nouvelles autorités nationales prévues par le règlement.

Les recours pour les personnes concernées

L'une des avancées majeures de l'AI Act est l'introduction d'un droit à l'explication pour les personnes affectées par des systèmes d'IA à haut risque. Concrètement: si une IA refuse votre candidature à un emploi, votre prêt bancaire ou votredossier de logement, vous avez le droit d'obtenir des explications intelligibles, et potentiellement de contester la décision.

Ce droit s'articule avec l'article 22 du RGPD (décision automatisée) et la directive sur la responsabilité IA pour former un premier écosystème de protection des individus face aux systèmes automatisés.

Comment faire valoir ses droits face à une IA?

Face à une décision ou une atteinte liée à un système d'IA, voici les leviers disponibles aujourd'hui.

1. Demander une explication : Toute décision automatisée à fort impact doit pouvoir être expliquée. Formulez votre demande par écrit, en visant à la fois le déployeur du système et, si possible, le fournisseur du modèle.

2.Exercer vos droits RGPD : Droitd'accès, de rectification, d'effacement, d'opposition au traitement automatisé. La CNIL propose des modèles de lettres disponibles sur son site.

3.Saisir la CNIL : Si un traitement devos données personnelles est en cause : photo utilisée pour entraîner un modèle, décision de scoring, collecte sans base légale, la CNIL est compétente. Elle dispose d'un pouvoir de sanction pouvant aller jusqu'à 20millions d'euros ou 4 % du chiffre d'affaires mondial.

4.Action en justice : Le tribunal judiciaire est compétent pour les actions civiles en responsabilité. En cas d'urgence (diffusion virale d'un deepfake, décision automatisée aux conséquences immédiates), le juge des référés peut intervenir en 48h.

5.Signaler à l'autorité nationale de supervision IA : Les États membres devront désigner une autorité compétente pour l'AI Act. En France, la désignation définitive était attenduepour 2025.

Conclusion : pour ou contre l'IA, la vraie question est réglementaire

Être pour ou contre l'IA est, en définitive, une question de valeurs. Mais être capable d'exercer ses droits face à l'IA, contester une décision automatisée, faire respecter la protection de ses données, comprendre les conditions dans lesquelles un outil vous évalue, est une question de connaissance juridique.

Le cadre réglementaire se densifie à vitesse accélérée : AI Act, directive sur la responsabilité IA, RGPD revisité à l'aune des modèles génératifs, premières jurisprudences sur les deepfakes et la propriété intellectuelle. À mesure que ce cadre se structure, le débat binaire « pour ou contre » devrait progressivement laisser place à une question plus utile : comment l'IA est-elle encadrée, et comment faire valoir vos droits face à elle ?

C'est précisément l'ambition de Ctrlzed : vous donner les clés pour naviguer dans un environnement numérique de plus en plus régulé. Les prochains articles de cette série entreront dans le détail des angles encore ouverts, propriété intellectuelle, empreinte écologique, responsabilité en chaîne.

Dans un monde où l'IA prend des décisions qui vous concernent, comprendre le droit qui l'encadre n'est plus une option. C'est une nécessité.

FAQ — Pour ou contre l'IA : vos questions juridiques

L'IA est-elle légalement encadrée en Europe ?

Oui. L'AI Act (Règlement UE2024/1689), entré en vigueur en août 2024, est le premier texte au monde àréguler l'IA de manière sectorielle. Il classe les systèmes par niveau derisque et impose des obligations proportionnées aux fournisseurs et déployeurs.

Peut-on contester une décision prise par une IA ?

Oui, dans les cas visés parl'article 22 du RGPD (décision automatisée ayant un effet significatif) et,désormais, par l'AI Act pour les systèmes à haut risque. Vous pouvez demander une explication, une révision humaine, et le cas échéant saisir la CNIL ou un tribunal.

Mes données ont-elles pu servir à entraîner une IA sans mon accord ?

C'est une question en cours de traitement juridique. Plusieurs autorités européennes ont ouvert des enquêtes sur la licéité de la collecte de données pour l'entraînement des LLM. Enthéorie, votre consentement ou une autre base légale valide est requis. En pratique, l'application reste complexe.

L'IA peut-elle utiliser mon image ou ma voix sans autorisation ?

Non. Votre image et votre voixsont des données personnelles au sens du RGPD, et des attributs de votre personnalité protégés par l'article 9 du Code civil. Toute utilisation non consentie est illicite, y compris pour l'entraînement de modèles génératifs oula création de deepfakes.

Qui est responsable quand une IA cause un préjudice ?

L'AI Act distingue le «fournisseur » (qui développe le modèle) et le « déployeur » (qui l'utilise). La responsabilité peut être partagée. La directive sur la responsabilité en matière d'IA, en cours de transposition, facilitera l'action des victimes en introduisant une présomption de causalité.

L'empreinte écologique de l'IA est-elle encadrée juridiquement ?

Pas encore directement. La directive CSRD impose aux grandes entreprises de déclarer leur empreinte environnementale numérique. Mais il n'existe pas encore de texte ciblant spécifiquement le coût écologique des modèles d'IA. C'est l'un des chantiers législatifs les plus attendus des prochaines années.

Article rédigé à des fins d'information juridique générale. Il ne constitue pas un conseil juridique. Pour toute situation spécifique, consultez un professionnel du droit.