Anthropic : l'entreprise qui a dit non au Pentagone

Fin février 2026, une start-up californienne de 4 000 personnes a tenu tête à l'administration Trump. Anthropic, créateur de l'assistant Claude, a refusé de livrer son intelligence artificielle à l'armée américaine sans conditions, et a payé le prix fort : blacklistée, désignée « risque pour la chaîne d'approvisionnement nationale », bannie des contrats fédéraux. Une décision sans précédent dans l'histoire de la tech américaine.

Cette affaire n'est pas qu'un conflit commercial. Elle pose, à voix haute, des questions que le droit numérique traite encore à voix basse : qui contrôle l'IA quand elle entre dans les systèmes militaires ? Une entreprise privée peut-elle fixer des limites à un État ? Et que révèle ce bras de fer sur l'état réel de la régulation de l'intelligence artificielle en 2026 ?

Pour la première fois, une entreprise américaine a été traitée comme un adversaire étranger, non parce qu'elle avait trahi, mais parce qu'elle avait refusé d'obéir.

Qu'est-ce qu'Anthropic ? L'entreprise que l'IA a faite dissidente

Une naissance par dissidence

Anthropic naît en 2021 d'une rupture. Dario Amodei, alors vice-président de la recherche chez OpenAI, quitte l'entreprise avec sa sœur Daniela et une dizaine de chercheurs seniors.

Le motif ? Un désaccord profond sur la direction prise par OpenAI : trop vite, trop peu sûr, trop alignée sur les intérêts commerciaux de Microsoft. Ce n'est pas un clash de personnes, c'est un désaccord philosophique sur ce que devrait être une IA responsable.

Ils cofondent Anthropic sous une forme juridique délibérément atypique : une Public Benefit Corporation, soit une société à mission d'utilité publique. L'objectif affiché, et inscrit dans les statuts : construire des systèmes d'IA fiables, interprétables et sûrs, même si cela ralentit la course aux performances.

Dario Amodei : l'architecte discret de l'IA éthique

Né en 1983 à San Francisco, Dario Amodei est physicien de formation, doctorat à Princeton, postdoc en neurosciences à Stanford. Une trajectoire scientifique qui explique son obsession pour la rigueur et l'interprétabilité. Il rejoint Google Brain, puis OpenAI, où il supervise le développement de GPT-2 et GPT-3.

Il est aussico-inventeur du RLHF (Reinforcement Learning from Human Feedback), la technique d'alignement qui structure aujourd'hui la plupart des grands modèles.

Figure volontairement discrète, il confie lui-même que « si les gens me trouvent ennuyeux et discret, c'est exactement ce que je veux », Amodei est pourtant l'un des penseurs les plus influents sur les risques à long terme de l'IA.

Sa contribution la plus emblématique chez Anthropic : le concept de «Constitutional AI », une méthode d'alignement où le modèle se critique et se corrige lui-même selon un ensemble de principes explicites et vérifiables.

"Je ne peux pas en bonne conscience accéder à la demande du Pentagone. Dans un nombre limité de cas, nous croyons que l'IA peut miner, plutôt que défendre,les valeurs démocratiques."

— Dario Amodei, PDG d'Anthropic, 27 février 2026

Claude : un modèle conçu pour refuser

Claude n'est pas un simple chatbot. C'est un modèle conçu dès l'origine pour avoir des limites, et les expliquer. Là où d'autres modèles cherchent à satisfaire toute requête, Claude intègre une « Constitution » : un corpus de principes éthiques publics auxquels il se réfère pour refuser certaines demandes.

En 2026, Claude est déployé dans les réseaux classifiés du Pentagone, utilisé pour l'analyse de renseignement, la planification opérationnelle, les cyberopérations. Il est le premier modèle d'IA à avoir été intégré aux systèmes militaires classifiés américains, et le seul, jusqu'à la rupture.

La chronologie d'une rupture : du contrat de 200 millions à la désignation ennemie

Un partenariat qui fonctionnait

L'histoire d'Anthropic et du Pentagone n'a pas toujours été conflictuelle. En 2024, via un partenariat avec Palantir, Claude est intégré aux réseaux classifiés du Département de la Défense, rebaptisé « Département de la Guerre » sous l'administration Trump. En juillet 2025, un contrat de 200 millions de dollars est signé. Le Pentagone connaissait les restrictions d'usage d'Anthropic. Il les acceptait.

Tout change en janvier 2026, quand Pete Hegseth signe une directive ordonnant que tous les contrats IA du Département de la Guerre incluent une clause d'utilisation «pour toute finalité légale », sans exception. C'est le début de la collision.

La chronologie des événements clés

Janvier 2026 — Hegseth signe une directive imposant à tous les prestataires IA une clause d'usage sans restriction.

Février 2026 (mi) — Révélation que Claude a été utilisé lors de l'opération de capture du président vénézuélien Nicolás Maduro. Anthropic interroge Palantir. Le Pentagone interprète la question comme un signe d'hostilité.

24 février 2026 — Hegseth envoie un ultimatum à Dario Amodei : lever toutes les restrictions d'ici le 27février à 17h01, sous peine de perdre le contrat et d'être désigné risque pourla chaîne d'approvisionnement.

27 février 2026 (matin) — Sam Altman déclare publiquement partager les lignes rouges d'Anthropic sur la surveillance de masse et les armes autonomes.

27 février 2026 (17h01) — Anthropic refuse. Trump publie sur Truth Social un post ordonnant à «CHAQUE AGENCE FÉDÉRALE de CESSER IMMÉDIATEMENT » d'utiliser Anthropic. Hegseth désigne Anthropic « risque pour la chaîne d'approvisionnement nationale », une première pour une entreprise américaine.

27 février 2026 (soir) — OpenAI annonce avoir signé un accord avec le Pentagone pour déployer ses modèles dans les réseaux classifiés. Altman est immédiatement accusé d'opportunisme.

3 mars 2026 — Altman reconnaît sur X que l'accord d'OpenAI était « opportuniste et bâclé ». Il amende le contrat pour y ajouter une clause explicite contre la surveillance domestique.

5 mars 2026 — Selon le Financial Times, Anthropic et le Pentagone seraient de retour à la table des négociations.

La désignation « supply chain risk » est un outil juridiqueréservé aux entreprises étrangères, et parfois aux adversaires. Son application à une société américaine est sans précédent et juridiquement fragile.

Les deux lignes rouges : surveillance de masse et armes autonomes

Pourquoi Anthropic refuse la surveillance de masse

La demande du Pentagone était précise : accès à Claude pour « toute finalité légale ». Dans ce que la version finale du contrat envoyée à Anthropic contenait, selon la société, des formulations permettant la collecte de données de géolocalisation, d'historiques de navigation et de dossiers financiers achetés auprès de databrokers, sans mandat judiciaire. En résumé : de la surveillance de masse des citoyens américains, légalement habillée.

La position d'Anthropic est juridiquement argumentée : ce type de collecte constitue une violation du 4e amendement de la Constitution américaine, qui protège contre les perquisitions et saisies abusives.

La société invoque également le RGPD et les principes fondamentaux de protection des données pour ses activités européennes.

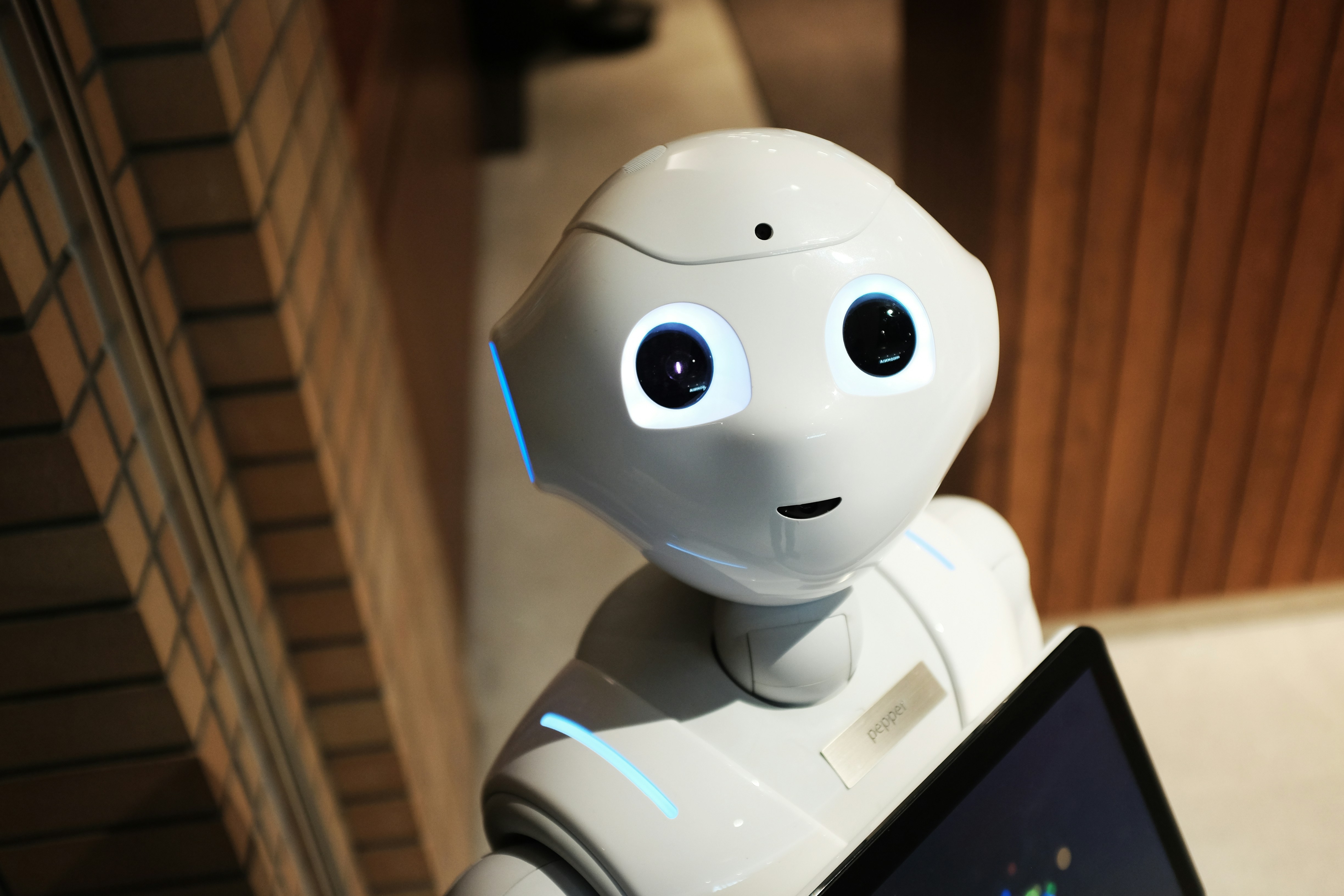

Pourquoi Anthropic refuse les armes létales autonomes

Le second refus porte sur les systèmes d'armes capables d'identifier et d'engager des cibles sans intervention humaine dans la chaîne de décision. La position technique d'Anthropic est claire : les modèles d'IA actuels, y compris Claude, ne sont pas suffisamment fiables pour ce type de décision irréversible. Un faux positif dans une recommandation musicale est bénin. Un faux positif dans un ciblage létal ne l'est pas.

Cette position rejoint les conclusions de l'AI Act européen, qui classe les systèmes d'IA dans les domaines critiques de sécurité comme des systèmes à haut risque soumis à supervision humaine obligatoire. Elle fait également écho aux appels répétés du Vatican, qui a qualifié les armes létales autonomes de « grave préoccupation éthique ».

"Nous ne croyons pas que les modèles d'IA frontaux actuels soient suffisamment fiables pour être utilisés dans des armes entièrement autonomes. Les permettre mettrait en danger nos soldats et des civils."

— Communiqué officiel d'Anthropic, 27 février 2026

Sam Altman, OpenAI et la tentation de l'opportunisme

La solidarité affichée

Le 27 févrierau matin, Sam Altman crée la surprise. Dans un mémo interne rendu public, le PDG d'OpenAI déclare partager les lignes rouges d'Anthropic : pas de surveillance de masse, pas d'armes autonomes, maintien d'un humain dans laboucle décisionnelle. Il affirme vouloir « aider à désamorcer les tensions » et ne pas croire que le Pentagone devrait menacer ces entreprises via le Defense Production Act.

Le message est reçu comme un acte de solidarité entre rivaux, Altman et Amodei sont d'anciens collègues d'OpenAI qui ont suivi des chemins radicalement opposés depuis 2021.

Le retournement du soir

Quelques heures après la désignation d'Anthropic par Trump, OpenAI annonce avoir signé son propre accord avec le Pentagone. L'opération est immédiatement perçue comme une substitution opportuniste : pendant qu'Anthropic brûlait, OpenAI prenait sa place. Les réactions sont vives, y compris en interne, où plusieurs chercheurs expriment leur malaise publiquement.

Altman le reconnaît lui-même, quelques jours plus tard, dans un post sur X : l'accord était « opportuniste et bâclé ». Il amende le contrat pour y intégrer une clause explicite sur la surveillance domestique et affirme avoir recommandé au Pentagone de lever la désignation d'Anthropic et de lui proposer les mêmes termes.

Altman ajouta à son contrat amendé exactement la clause pour laquelle Anthropic avait été punie. Ce retournement en dit long sur ce que la solidarité vaut en Silicon Valley et sur ce que le Pentagone accepte quand il y a intérêt.

Les implications juridiques : ce que cette affaire change pour le droit de l'IA

La désignation « supply chain risk » est-elle légalement solide ?

L'analyse de la revue Lawfare est sans ambiguïté : la désignation d'Anthropic comme risque pourla chaîne d'approvisionnement nationale présente de sérieuses failles juridiques. La loi américaine réserve cet outil aux menaces étrangères.

L'appliquer à une entreprise américaine qui refuse simplement de lever ses conditions contractuelles est juridiquement inédit, et vulnérable en justice.

Lac ontradiction est flagrante : d'un côté, le gouvernement affirme qu'Anthropice st indispensable à la sécurité nationale (au point d'envisager le DefenseProduction Act pour forcer l'accès à sa technologie) ; de l'autre, il la désigne comme risque sécuritaire et ordonne son éviction de l'ensemble des systèmes fédéraux. Ces deux positions sont logiquement incompatibles. Anthropica annoncé son intention de contester la désignation en justice.

Le conflit entre contrat privé et impératif militaire

Cette affaire soulève une question de droit numérique fondamentale : jusqu'où une entreprise privée peut-elle imposer des conditions d'usage à un client public, y compris à l'armée ? Aucun texte juridique américain ne donne aujourd'hui une réponse claire. L'AI Act européen, lui, impose des garde-fous pour les systèmes à hautrisque, indépendamment du client. C'est précisément ce modèle réglementaire qu'Anthropic invoquait dans sa défense.

Un précédent pour toute l'industrie

Si le gouvernement américain avait obtenu gain de cause sans résistance, le message envoyé à toute l'industrie IA aurait été limpide : les garde-fous éthiques sont négociables sous pression politique. La résistance d'Anthropic, quel que soitson dénouement final, a forcé le débat dans l'espace public. Elle a également contraint OpenAI à formaliser ses propres lignes rouges dans un contrat signé. C'est un précédent normatif, même sans valeur juridique formelle.

L'affaire Anthropic-Pentagone est la première grande jurisprudence de fait sur les limites contractuelles de l'IA militaire. Elle arrivera devant les tribunaux, ou devant le Congrès.

Conclusion : Anthropic a perdu le contrat, mais peut-être pas le débat

En refusant de se soumettre à une demande gouvernementale sans précédent, Anthropic a pris un risque financier considérable, et ouvert un débat que les régulateurs ne peuvent plus ignorer. Peut-on forcer une entreprise à livrer une technologie sans conditions ? Qui supervise l'IA quand elle entre dans les réseaux militaires classifiés ? Comment garantir qu'un modèle d'IA ne sera pas utilisé pour surveiller les citoyens ou déclencher des frappes sans accord humain ?

Ces questions n'ont pas de réponse juridique solide aujourd'hui, ni aux États-Unis, ni en Europe, où l'AI Act reste silencieux sur les usages souverains et militaires. Mais elles sont désormais posées à voix haute. Et les prochains articles de Ctrlzed les traiteront une par une.

Ctrlzed vous propose une série complète sur l'IA et le droit militaire, la surveillance numérique et la responsabilité des modèles d'IA. Retrouvez les prochains articles.

FAQ — Anthropic, Claude et le Pentagone

Pourquoi Anthropica-t-elle refusé la demande du Pentagone ?

Anthropic a refusé d'accorder à l'armée un accès sans restriction à Claude, en maintenant deux interdictions : l'utilisation pour la surveillance de masse des citoyens américains, et l'utilisation pour des armes létales entièrement autonomes sans supervision humaine. La société estime que ces usages violent à la fois les droits fondamentaux et les limites techniques actuelles de l'IA.

Qu'est-ce que la désignation « supply chain risk » ?

C'est un mécanisme juridique américain qui permet au gouvernement de restreindre ou interdire les relations commerciales d'une entreprise avec les contractants militaires. Historiquement réservé aux entreprises étrangères ou adversaires, son application à une entreprise américaine comme Anthropic est une première, et fait l'objet d'une contestation judiciaire annoncée.

Sam Altman a-t-il vraiment soutenu Anthropic ?

Publiquement, oui, dans un mémo du 27 février, il a déclaré partager les lignes rouges d'Anthropic. Mais quelques heures plus tard, OpenAI annonçait son propre accord avec le Pentagone. Altman a par la suite admis que l'accord avait été « opportuniste et bâclé » et a amendé le contrat pour y ajouter des clauses similaires à celles qu'Anthropic défendait.

Claude est-il encore utilisé par l'armée américaine ?

Selon les informations disponibles début mars 2026, le Pentagone a accordé une période de transition de six mois. Des rapports indiquent que Claude aurait même été utilisé lors des frappes américaines sur l'Iran, l'heures après l'annonce du bannissement. Anthropic serait par ailleurs retourné à la table des négociations selon le Financial Times.

Quel impact cette affaire a-t-elle sur la régulation européenne de l'IA ?

Elle renforce la pertinence de l'AI Act, qui impose une supervision humaine obligatoire pour les systèmes d'IA à haut risque, y compris dans les domaines de sécurité. Mais le règlement européen laisse un angle mort majeur : les usages militaires et souverains restent largement hors de son périmètre. Ce vide législatif sera un sujet législatif majeur en 2026-2027.

Qui est Dario Amodei ?

Physicien de formation, cofondateur d'Anthropic en 2021 après avoir été vice-président de la recherche chez OpenAI, Dario Amodei est l'un des acteurs les plus influents de la sécurité IA mondiale. Il défend depuis sa fondation d'Anthropic l'idée que la sécuritédes modèles n'est pas un frein à la performance, mais une condition de leur utilité réelle à long terme.

Article rédigé à des fins d'information juridique et journalistique générale. Il ne constitue pas un conseil juridique. Pour toute situation spécifique, consultez un professionnel du droit.