ChatGPT et le droit : la métamorphose silencieuse de la raison juridique

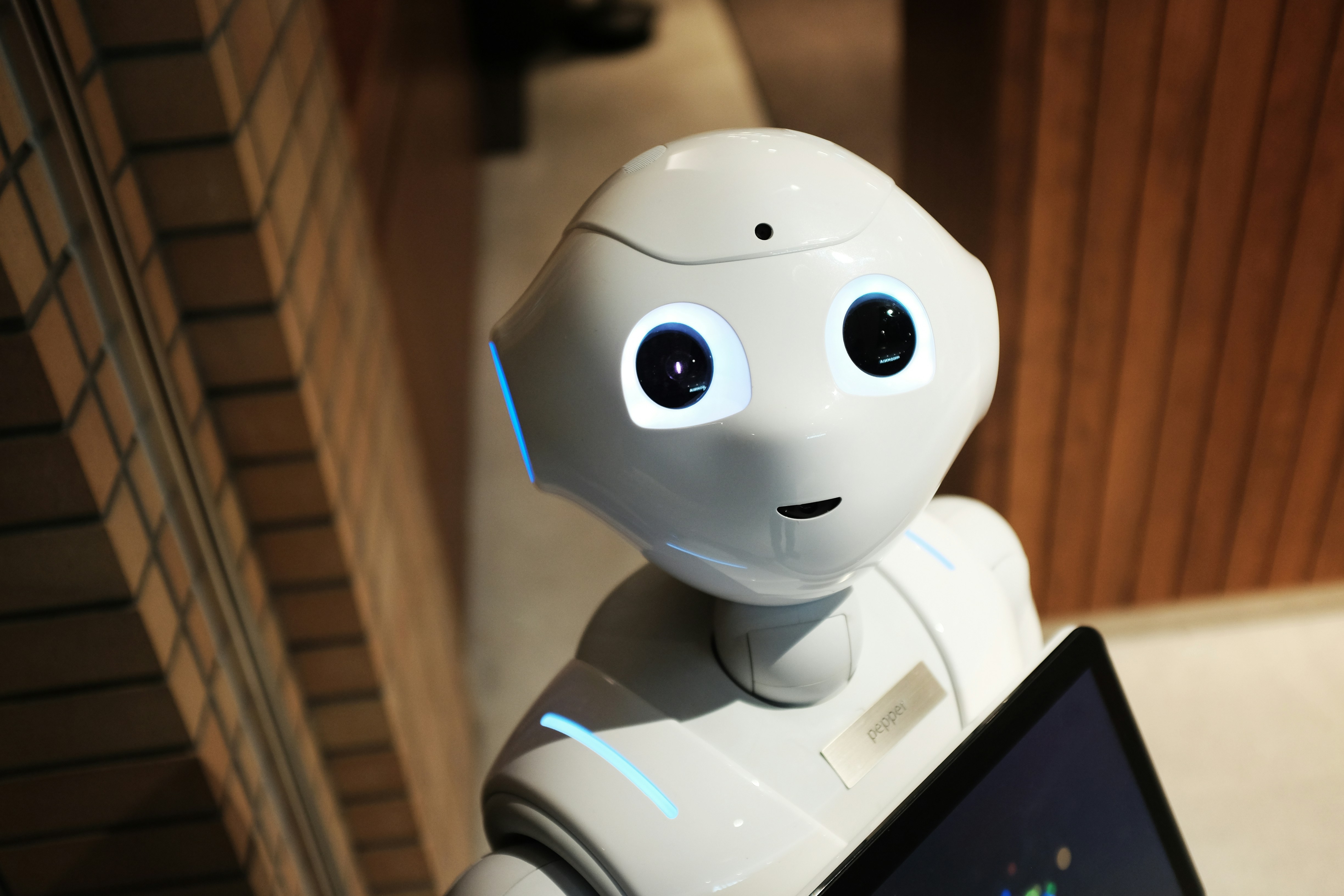

Pendant des siècles, le droit a représenté l’expression la plus accomplie de la rationalité humaine : un système de signes ordonné, hiérarchisé, interprété par des esprits formés à l’art du raisonnement. Aujourd’hui, cette rationalité entre en dialogue, parfois en tension, avec une nouvelle forme d’intelligence : celle des modèles de langage génératif. Dans ce contexte, ChatGPT bouleverse le droit, tant par son potentiel d’assistance que par les questions qu’il soulève sur la compréhension réelle des normes. L’enjeu n’est plus de savoir si l’intelligence artificielle peut produire du texte juridique, mais jusqu’où elle peut en saisir la logique et la portée.

Une révolution silencieuse dans les pratiques juridiques

La pénétration de ChatGPT dans le monde juridique s’est faite sans fracas. En quelques mois, des milliers de juristes, avocats, enseignants, magistrats et étudiants ont intégré l’outil dans leurs routines, souvent par curiosité, parfois par nécessité.

Ce qui frappe d’abord, c’est la plasticité de l’usage : la même interface sert à rédiger des clauses contractuelles, à reformuler un argument, à synthétiser un arrêt, à vulgariser un principe de droit ou à préparer une plaidoirie.

Le gain de temps est indéniable. Là où la rédaction d’un contrat-type pouvait autrefois requérir une demi-journée de travail, quelques minutes suffisent désormais pour obtenir une version préliminaire structurée, argumentée et présentée selon les standards rédactionnels du métier. Cette accélération de la production juridique n’est pas anodine : elle transforme la temporalité même du droit.

Le juriste devient moins un scribe qu’un chef d’orchestre cognitif, coordonnant la machine plutôt que ses assistants humains.

Mais cette transformation a un revers. Si ChatGPT produit des textes d’une impressionnante cohérence formelle, il ne comprend pas la norme qu’il articule. Il simule la pensée juridique sans la posséder. C’est là le paradoxe fondateur de ce nouvel âge : le juriste reste indispensable, mais son rôle se déplace du producteur de texte vers le garant de la validité normative.

De la bibliothèque à l’algorithme : la mutation épistémologique du droit

L’arrivée de ChatGPT marque un tournant comparable à celui qu’a représenté l’imprimerie pour la diffusion du savoir juridique à la Renaissance.

Autrefois, le juriste devait connaître par cœur les arrêts fondamentaux, manipuler les recueils et dompter la jurisprudence par la mémoire. Aujourd’hui, il dialogue avec une machine qui peut, en une requête, condenser des milliers de décisions.

Mais ce changement n’est pas seulement technique : il est épistémologique.

ChatGPT fonctionne selon une logique probabiliste, non déductive.

Il ne raisonne pas à partir de la norme pour en déduire un effet, mais prévoit le mot suivant le plus vraisemblable dans un contexte donné. Autrement dit, il mime le discours juridique sans accéder à sa dimension argumentative.

Cette différence est capitale : elle explique pourquoi les textes produits peuvent être grammaticalement impeccables, mais juridiquement erronés.

C’est ici que s’ouvre un champ fascinant : celui d’une épistémologie de l’assistance algorithmique.

Comment une machine, qui ne comprend pas, peut-elle néanmoins participer à la production de sens dans une discipline fondée sur la rationalité interprétative ?

La réponse se situe sans doute dans l’idée que ChatGPT ne remplace pas le juriste : il augmente sa capacité d’abstraction. En générant des hypothèses, des trames, des variantes, l’IA devient un outil de stimulation intellectuelle, un miroir heuristique des raisonnements possibles.

Pour aller plus loin, consultez notre article sur le Droit numérique : « droit-numérique : définition, enjeux 2025 et pourquoi il est partout ».🔗

L’art du prompt juridique : écrire pour penser avec la machine

L’efficacité de ChatGPT dépend presque entièrement de la précision du prompt.

Un prompt mal formulé engendre des réponses génériques ; un prompt rigoureux transforme l’outil en véritable assistant spécialisé.

Or, l’écriture du prompt n’est pas anodine : elle constitue une nouvelle compétence juridique.

Savoir « parler à la machine » devient un savoir-faire professionnel, comparable à la maîtrise de la méthodologie du commentaire d’arrêt ou de la note de synthèse.

Un bon prompt juridique repose sur plusieurs piliers : rôle, contexte, tâche, objectif, ton, format et contraintes.

Ce cadre structure la pensée artificielle et oriente la réponse vers la rigueur attendue d’un raisonnement juridique.

Ce n’est pas un simple dialogue : c’est une mise en scène du raisonnement.

Le juriste devient scénariste de la pensée artificielle. Il écrit non pas pour obtenir un texte, mais pour provoquer une réflexion structurée.

Certaines facultés de droit ont d’ailleurs commencé à enseigner cette compétence émergente, en intégrant dans leurs cours des ateliers de prompt engineering juridique : une nouvelle grammaire du raisonnement à l’ère de l’IA.

L’impact sur les études de droit : une pédagogie à repenser

L’irruption de ChatGPT dans les universités juridiques bouleverse les méthodes d’apprentissage autant qu’elle interroge les valeurs fondatrices de la formation en droit.

Jusqu’ici, l’enseignement reposait sur la rigueur du raisonnement personnel, la lecture des sources, la maîtrise des structures argumentatives et l’effort de synthèse. Désormais, une grande partie de ces processus peut être assistée, voire automatisée, par des outils d’intelligence artificielle.

Les promesses pédagogiques

D’un point de vue positif, ChatGPT ouvre une ère d’apprentissage plus dynamique et individualisé.

L’étudiant peut interagir directement avec le savoir juridique : poser des questions, reformuler un arrêt, demander une explication de texte, ou même simuler une plaidoirie.

L’IA rend le droit plus accessible, notamment pour ceux qui peinent à maîtriser le langage technique.

Elle devient un tuteur virtuel, disponible 24 heures sur 24, capable d’expliquer les notions fondamentales avec clarté, de simplifier les raisonnements et d’offrir un feedback immédiat.

Dans ce contexte, ChatGPT ne remplace pas le professeur : il complète la pédagogie magistrale par une approche dialogique, plus proche du questionnement socratique que du cours descendant.

De plus, l’outil favorise l’autonomie : les étudiants apprennent à formuler leurs propres questions, à tester des hypothèses et à manipuler la norme dans des situations simulées.

Certains enseignants en tirent parti pour construire des cas pratiques interactifs, ou pour confronter les étudiants à des raisonnements contradictoires issus de l’IA, que ces derniers doivent corriger, commenter ou enrichir.

Les dérives et fragilités

Mais cette révolution comporte un risque majeur : celui de la passivité intellectuelle.

Le danger n’est pas tant que les étudiants trichent, mais qu’ils cessent d’apprendre à raisonner.

Si l’effort d’analyse, de rédaction et de construction du syllogisme juridique est délégué à la machine, la formation perd son essence : celle qui forge la rigueur, la nuance et la prudence propres au raisonnement juridique.

Les enseignants observent déjà une standardisation du style et des erreurs récurrentes issues des réponses générées. Des copies d’examen reprennent les tournures typiques de ChatGPT, parfois sans discernement.

Le risque est donc double : un affaiblissement de la créativité argumentative et une dépendance cognitive à l’outil.

Ce phénomène dépasse d’ailleurs le milieu universitaire. Dans une vidéo devenue virale sur YouTube,

plusieurs juristes américains racontent comment l’usage non critique de l’IA les a conduits à présenter devant les tribunaux des mémoires contenant des citations juridiques inventées.

Cet épisode, largement relayé dans la presse, rappelle que ChatGPT n’a pas de conscience juridique : il ne distingue pas une vérité normative d’une simple construction linguistique.

Autrement dit, l’illusion de fiabilité peut devenir un piège surtout lorsque la rigueur méthodologique laisse place à la confiance aveugle.

Sur un plan éthique, la question du plagiat devient plus floue.

Un texte produit par une IA peut être “original” dans la forme, mais non dans l’esprit.

Les universités doivent donc repenser leurs modes d’évaluation, en valorisant davantage l’oral, la discussion, l’interprétation critique tout ce que l’IA ne sait pas encore faire.

Vers une formation augmentée

Le défi consiste à transformer ChatGPT non en raccourci, mais en compagnon de pensée.

Utilisé avec discernement, il peut aider l’étudiant à structurer ses idées, à repérer des failles logiques, à visualiser la hiérarchie des normes ou à simuler des cas complexes.

L’enjeu pour les enseignants n’est donc pas d’interdire l’IA, mais d’apprendre à enseigner avec elle.

Former à l’usage critique de ces outils deviendra sans doute, dans les années à venir, une composante incontournable de la formation juridique au même titre que la méthodologie du cas pratique ou du commentaire d’arrêt.

Comparaison internationale : la France est-elle en retard ?

Sur la scène mondiale, les approches divergent radicalement.

Aux États-Unis, l’usage de ChatGPT dans le droit a déjà pris une tournure industrielle. Les legal techs comme Harvey, Casetext (acquis par Thomson Reuters) ou DoNotPay se sont imposées comme des auxiliaires quasi-naturels du travail d’avocat.

De grands cabinets d’affaires, notamment à New York et San Francisco, testent des modèles internes fondés sur GPT-4, entraînés sur leurs propres bases de données confidentielles. L’objectif : accélérer la recherche juridique et la génération de documents tout en respectant le secret professionnel.

Les universités américaines, quant à elles, adoptent une approche pragmatique : elles intègrent déjà des cours de Legal AI Literacy, où les étudiants apprennent à utiliser et auditer des modèles d’IA juridique.

En Asie, la Chine et Singapour investissent massivement dans les projets de smart justice. Des tribunaux semi-numérisés y utilisent déjà des algorithmes pour la classification automatique des litiges et la suggestion de peines, sous supervision humaine.

Si ces systèmes soulèvent d’immenses questions éthiques, ils témoignent d’une volonté politique de fusionner la technologie et la justice.

La France, elle, avance à pas prudents.

Les initiatives restent principalement universitaires ou expérimentales : les facultés de droit commencent tout juste à introduire des modules sur l’IA et l’éthique numérique, tandis que les Ordres professionnels rappellent les risques déontologiques.

Cette prudence a ses vertus elle protège le secret et la rigueur méthodologique, mais elle révèle aussi un retard structurel : peu d’investissements publics dans la legal tech, peu de programmes de recherche transdisciplinaires entre juristes et ingénieurs.

En Europe, c’est sans doute le Royaume-Uni qui se positionne le plus stratégiquement. Londres est devenue la capitale européenne du Legal AI, portée par des universités comme Oxford et Cambridge qui collaborent directement avec les géants de l’IA.

La France, malgré une doctrine juridique d’exception, souffre encore d’un déficit d’intégration technologique. Le défi des prochaines années sera donc d’aligner cette tradition intellectuelle avec les exigences de l’ère numérique : concevoir une IA qui parle la langue du droit civil, sans renoncer à la précision du raisonnement à la française.

L’éthique de l’assistance algorithmique

Derrière la fascination technologique se cache un enjeu plus profond : celui de l’autonomie du jugement humain.

Si ChatGPT peut rédiger une clause, suggérer un argument ou simuler un raisonnement, il ne peut ni assumer la responsabilité d’un conseil, ni percevoir les implications morales d’une décision.

Le droit n’est pas seulement une technique, c’est aussi une éthique du discernement.

Accepter l’aide de la machine ne signifie pas lui déléguer la décision, mais reconfigurer l’équilibre entre efficacité et prudence.

Une « éthique de l’assistance algorithmique » pourrait ainsi reposer sur trois principes :

la transparence, la responsabilité et la complémentarité.

Ce cadre moral n’est pas qu’un vœu pieux : il conditionne la légitimité du droit dans un monde où les algorithmes participent à la production du sens.

ChatGPT ne signe pas la fin du juriste, mais le début d’une nouvelle forme de pratique intellectuelle.

Il n’a pas vocation à remplacer la réflexion humaine, mais à l’enrichir, à la stimuler, à l’étendre dans des directions inattendues.

Utilisé avec rigueur, il peut devenir un outil d’émancipation cognitive ; mal utilisé, il n’est qu’un miroir déformant du savoir juridique.

Le droit, discipline de la raison, ne peut se contenter d’être généré : il doit être interprété, discuté, incarné.

C’est pourquoi l’avenir du juriste ne dépendra pas de sa résistance à l’IA, mais de sa capacité à en garder la main.

Non pas pour dominer la machine, mais pour lui rappeler que la justice, elle, ne se calcule pas : elle se pense.

ChatGPT et le droit

ChatGPT peut-il aider à réviser une licence de droit ?

Oui, ChatGPT peut assister dans la compréhension des notions fondamentales en droit privé, droit public, droit pénal, ou droit administratif. Il peut également aider à structurer des fiches de révision ou simuler des cas pratiques, notamment en droit des contrats ou droit du travail. Cela reste un outil complémentaire à l’enseignement dispensé en UFR de droit.

Peut-on utiliser ChatGPT pour rédiger des cas pratiques en droit ?

Absolument, pour s’exercer ou s'entraîner. Il peut proposer des scénarios ou des analyses juridiques en lien avec des matières comme le droit fiscal, le droit des affaires ou le droit social, en suivant les méthodes juridiques classiques. Toutefois, seul un enseignant ou un tuteur peut valider la pertinence juridique des arguments.

Un étudiant peut-il utiliser ChatGPT pour préparer son Master en droit ?

Oui, notamment pour explorer différentes spécialisations comme la propriété intellectuelle, le contentieux administratif, le droit international, ou encore le droit des sociétés. ChatGPT peut également aider à formuler des lettres de motivation ou comprendre les attendus des semestres du Master Droit.

Est-ce que ChatGPT peut simuler un entretien pour intégrer un Master ou un cabinet ?

Oui. Il peut simuler un entretien de sélection pour un Master droit, ou un entretien professionnel dans un cabinet d’avocats ou une entreprise. Cela permet de se préparer à valoriser son parcours droit, ses compétences, sa maîtrise du contentieux, ou encore ses choix de spécialisation (ex. : propriété industrielle, protection sociale, etc.).

ChatGPT peut-il aider un juriste d’entreprise dans ses tâches quotidiennes ?

Oui, à condition d’en faire un usage maîtrisé. Il peut assister à la rédaction de notes juridiques, synthèses de textes, ou alertes légales en droit des affaires ou droit des sociétés, voire suggérer des trames contractuelles. Il est cependant essentiel qu’un juriste titulaire d’une formation initiale solide contrôle les contenus produits.

ChatGPT peut-il être utilisé lors des séminaires ou TD à la faculté de droit ?

Certaines facultés de droit l’autorisent sous condition. Il peut enrichir la réflexion lors de séminaires ou travaux dirigés, mais ne remplace pas la compréhension doctrinale ou jurisprudentielle. Des dispositifs de détection du plagiat sont de plus en plus utilisés pour prévenir les abus.

ChatGPT est-il adapté au droit comparé ou au droit international ?

Oui, ChatGPT peut être un point de départ pour explorer différentes traditions juridiques, systèmes de droit international public ou privé, ou encore comparer les règles de droit administratif entre pays. Il ne remplace toutefois pas les bases doctrinales solides nécessaires à ces disciplines.

Peut-on utiliser ChatGPT pour automatiser certaines tâches juridiques ?

Dans un cadre professionnel encadré, oui. Il peut participer à l’automatisation de recherches, la génération de réponses types ou l’analyse de contrats. Cela peut faciliter l’insertion professionnelle dans les professions juridiques modernes, en particulier dans les directions juridiques innovantes ou les legal techs.